Lesiones de la médula espinal o enfermedades impiden las señales del cerebro lleguen a los músculos por debajo de la lesión. En experimentos recientes, los científicos han estado empleando interfaces cerebro-máquina para que los pacientes con parálisis puedan mover prótesis con su mente. Ahora, una paciente con tetraplejia ha sido capaz de utilizar su mente para mover un brazo robótico, lo que demuestra “el control cerebral de 10 grados” de la prótesis.

Los resultados de la última prueba, que fue realizado por investigadores de la Universidad de Pittsburgh School of Medicine en Pennsylvania, se publicaron en la revista Journal of Neural Engineering .

La mujer que participó en el estudio es de 56 años de edad Ene Scheuermann, que es tetrapléjica y fue diagnosticada con una variante de la degeneración espinocerebelosa sin la participación del cerebelo.

En febrero de 2012, el equipo implanta quirúrgicamente pequeñas rejillas de electrodos con 96 puntos de contacto pequeños cada uno en las regiones del cerebro de Scheuermann que – en circunstancias normales – controlan su brazo derecho y movimiento de la mano.

Los electrodos fueron capaces de captar señales de las neuronas individuales, que luego se comunicaban con un equipo que identificó patrones de disparo asociados con ciertos movimientos observados o imaginados, incluyendo levantar y bajar el brazo.

Los resultados de ese estudio inicial – en la que Scheurmann fue capaz de ir tan lejos como para flexionar la muñeca del brazo prostético de ida y vuelta, moverlo de lado a lado, rotar y agarrar objetos – demostraron “control 7D”. Los hallazgos fueron publicados en la revista The Lancet en 2012.

Pero en este último estudio, dirigido por el Prof. Andrew Schwartz, de la Escuela de Medicina de Pitt, Scheurmann era capaz de dominar “10D control”, que involucró a mover la mano robótica en diferentes posiciones, mientras que el control de la muñeca y el brazo.

“Los resultados muestran el movimiento se puede restaurar a las personas con parálisis ‘

Prof. Schwartz y sus colegas explican que las interfaces cerebro-máquina (IMC) “ofrece la posibilidad de pasar por el tejido dañado por la decodificación de movimiento de intención y el control de los dispositivos de ayuda” – tales como cursores de ordenador o brazos robóticos.

“Nuestro proyecto ha demostrado que podemos interpretar las señales de las neuronas con un algoritmo simple ordenador para generar movimientos sofisticados y fluidos que permiten al usuario interactuar con el medio ambiente”, dice Jennifer Collinger, científico investigador y profesor asistente en Pitt.

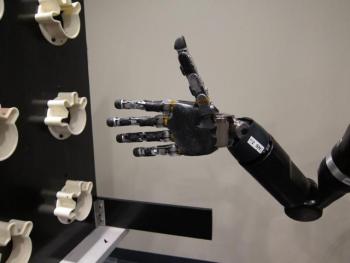

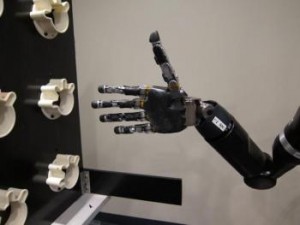

Para su último trabajo, el equipo reemplazó el agarre de pinza simple en la prótesis de brazo con cuatro formas de la mano: la abducción del dedo, cucharada, la oposición del pulgar y una pizca de las pulgar, índice y medio dedos, con lo que el total de los movimientos de brazos y manos al 10 .

Durante el experimento, Scheurmann observaba animaciones de los movimientos y los imaginó, y el equipo registra las señales de su cerebro envía a calibrar el sistema. A continuación, utilizaron esa información para “leer sus pensamientos”, lo que le permite mover la mano en las posiciones deseadas.